Robots.txt协议的写法及屏蔽文件

网站的robots.txt文件设置是不是合理,哪些文件或许目录需求屏蔽、哪些设置办法对网站运营有优点?有人复制出相同的内容以应付不同搜索引擎的排名规则。然而,一旦搜索引擎发现站内有大量“克隆”的页面,就会给以惩罚,不收录这些重复的页面。

另一方面,我们网站的内容属于个人私密文件,不想暴露在搜索引擎中。这时,robot.txt就是为了解决这两个问题。

一、什么是robots.txt?

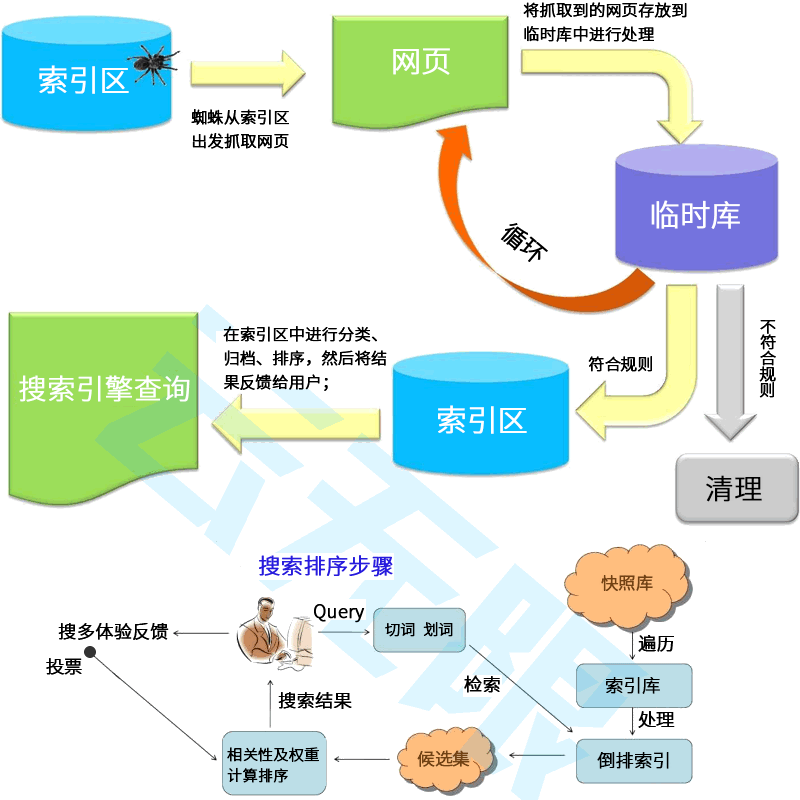

robots.txt 是网站和搜索引擎的协议的纯文本文件。当一个搜索引擎蜘蛛来访问站点时,它首先爬行来检查该站点根目录下是否存在robots.txt,

如果存在,根据文件内容来确定访问范围,如果没有,蜘蛛就沿着链接抓取。robots.txt 放在项目的根目录下。

二、 robots.txt基本语法:

1) 、允许所有搜索引擎访问网站的所有部分

robots.txt写法如下:

User-agent: *

Disallow:

或者

User-agent: *

Allow: /

注意: 1. ****个英文要大写,冒号是英文状态下,冒号后面有一个空格,这几点一定不能写错。

2) 、禁止所有搜索引擎访问网站的所有部分

robots.txt写法如下:

User-agent: *

Disallow: /

3) 、只需要禁止蜘蛛访问某个目录,比如禁止admin、css、images等目录被索引

robots.txt写法如下:

User-agent: *

Disallow: /css/

Disallow: /admin/

Disallow: /images/

注意:路径后面有斜杠和没有斜杠的区别:比如Disallow: /images/ 有斜杠是禁止抓取images整个文件夹,Disallow: /images 没有斜杠意思是凡是路径里面有/images关键词的都会被屏蔽

4)、屏蔽一个文件夹/templets,但是又能抓取其中一个文件的写法:/templets/main

robots.txt写法如下:

User-agent: *

Disallow: /templets

Allow: /main

5)、 禁止访问/html/目录下的所有以”.php”为后缀的URL(包含子目录)

robots.txt写法如下:

User-agent: *

Disallow: /html/*.php

6)、 仅允许访问某目录下某个后缀的文件,则使用“$”

robots.txt写法如下:

User-agent: *

Allow: .html$

Disallow: /

7)、禁止索引网站中所有的动态页面

比如这里限制的是有“?”的域名,例如index.php?id=1

robots.txt写法如下:

User-agent: *

Disallow: /*?*

8)、 禁止搜索引擎抓取我们网站上的所有图片(如果你的网站使用其他后缀的图片名称,在这里也可以直接添加)

有些时候,我们为了节省服务器资源,需要禁止各类搜索引擎来索引我们网站上的图片,这里的办法除了使用“Disallow: /images/”这样的直接屏蔽文件夹的方式之外,还 可以采取直接屏蔽图片后缀名的方式。

robots.txt写法如下:

User-agent: *

Disallow: .jpg$

Disallow: .jpeg$

Disallow: .gif$

Disallow: .png$

Disallow: .bmp$

三、写robots.txt要注意的地方:

1)、 ****个英文要大写,冒号是英文状态下,冒号后面有一个空格,这几点一定不能写错。

2.)、斜杠:/ 代表整个网站

3)、如果“/”后面多了一个空格,则屏蔽整个网站

4)、不要禁止正常的内容

5)、生效时间是几天到两个月

四、robots.txt文件对网站优化有什么作用?

1、疾速增加网站权重和拜访量;

2、制止某些文件被查找引擎索引,能够节约服务器带宽和网站拜访速度;

3、为查找引擎供给一个简洁明了的索引环境

五、哪些网站的目录需求运用robots.txt文件制止抓取?

1)、图像目录

图像是构成网站的首要组成元素。跟着现在建站越来越便利,许多cms的呈现,真实做到了会打字就会建网站,而正是由于如此便利,网上呈现了许多的同质化模板网站,被重复运用,这样的网站查找引擎是必定不喜爱的,就算是你的网站被录入了,那你的作用也是很差的。若是你非要用这种网站的话,主张你大概在robots.txt文件中进行屏蔽,一般的网站图像目录是:imags 或许 img;

2)、网站模板目录

cms的强大和灵敏,也致使了许多同质化的网站模板的呈现和乱用,高度的重复性模板在查找引擎中形成了一种冗余,且模板文件常常与生成文件高度类似,相同易形成相同内容的呈现。对查找引擎很不友爱,严峻的直接被查找引擎打入冷宫,不得翻身,许多cms有具有独立的模板寄存目录,因而,大概进行模板目录的屏蔽。一般模板目录的文件目录是:templets

3)、css、js目录的屏蔽

css目录文件在查找引擎的抓取中没有用途,也无法供给有价值的信息。所以强烈主张在robots.txt文件中将其进行屏蔽,以进步查找引擎的索引质量。为查找引擎供给一个简洁明了的索引环境更易晋升网站友爱性。css款式的目录一般情况下是:css 或许 style,

js文件在查找引擎中无法进行辨认,这里仅仅主张,能够对其进行屏蔽,这样做也有一个优点:为查找引擎供给一个简洁明了的索引环境;

4)、屏蔽双页面的内容

这里拿dedecms来举例吧。dedecms能够运用静态和动态url进行同一篇内容的拜访,若是你生成全站静态了,那你有必要屏蔽动态地址的url连接。

这里有两个优点:

①、查找引擎对静态的url比动态的url更友爱、更简单录入;

②、避免静态、动态url能拜访同一篇文章而被查找引擎判为重复内容。这样做对查找引擎友爱性来说是有益无害的。

5)、模板缓存目录

许多cms程序都有缓存目录,这种缓存目录的优点我想不用说我们也明白了吧,能够十分有用的晋升网站的拜访速度,削减网站带宽,对用户体会也是极好的。不过,这样的缓存目录也有必定的缺陷,那就是会让查找引擎进行重复的抓取,一个网站中内容重复也是大祭,对网站百害而无一利。许多运用cms建站的兄弟都没有注意到,有必要要导致注重。

6)、被删去的目录

死链过多,对查找引擎优化来说,是丧命的。不能不导致站长的高度注重,。在网站的开展过程中,目录的删去和调整是不可避免的,若是你的网站当时目录不存在了,那有必要对此目录进行robots屏蔽,并回来正确的404过错页面。

这里有一个争议性的疑问,关于网站后台办理目录是不是需求进行屏蔽,其实这个可有可无。在能确保网站安全的情况下,若是你的网站运营规划较小,就算网站目录呈现在robots.txt文件中,也没有多大疑问,这个我也见过许多网站这样设置的;但若是你的网站运营规划较大,对手过多,强烈主张千万别呈现网站后台管理目录的信息,以防被心怀叵测的人使用,危害你的利益;引擎越来越智能,关于网站的管理目录仍是能极好的辨认,并抛弃索引的。别的,我们在做网站后台的时分,也能够在页面元标签中增加:进行查找引擎的屏蔽抓取。

SEO就是搜索引擎优化:让你的网站在搜索引擎(比如百度、谷歌)的排名更靠前,当用户通过关键词搜索时更容易搜到你的网站,从而实现企业品牌曝光、主动获客和营销推广的目标。

为什么要做SEO?

提高网站访问量:SEO能让你的网站在搜索引擎结果中更靠前,吸引更多客户点击。

降低市场营销成本:相比于付费广告,SEO是一种更经济有效的营销方式。

提升品牌知名度:网站排名靠前,可以让更多用户看到你的品牌名称和信息,增强品牌影响力。

SEO优化有哪些优势?

SEO优化有哪些优势?成本低廉:主要成本是优化师的工资。

效果稳定:一旦网站排名上升,效果稳定持久,可持续获得展现机会。

不受地域限制:SEO的效果可以覆盖全球,不受时间和空间的限制。

什么样的公司更适合做SEO优化呢?大多数行业都可以从SEO中受益。特别是那些希望用户主动访问我们的网站、降低营销成本、提升品牌知名度的企业。通过SEO来优化自己的网站,可吸引更多潜在客户。

SEO是一种工人的有效的网络营销手段,可以帮助企业提升关键词排名,吸引更多用户,实现商业目标。SEO是一个长期且专业的技术,企业在进行SEO时,必须耐心优化,因为SEO涉及到的不止是网站结构、内容质量、用户体验、外部链接这几个方面;还有算法的更替、蜘蛛的引导、快照的更新、参与排序的权重等。

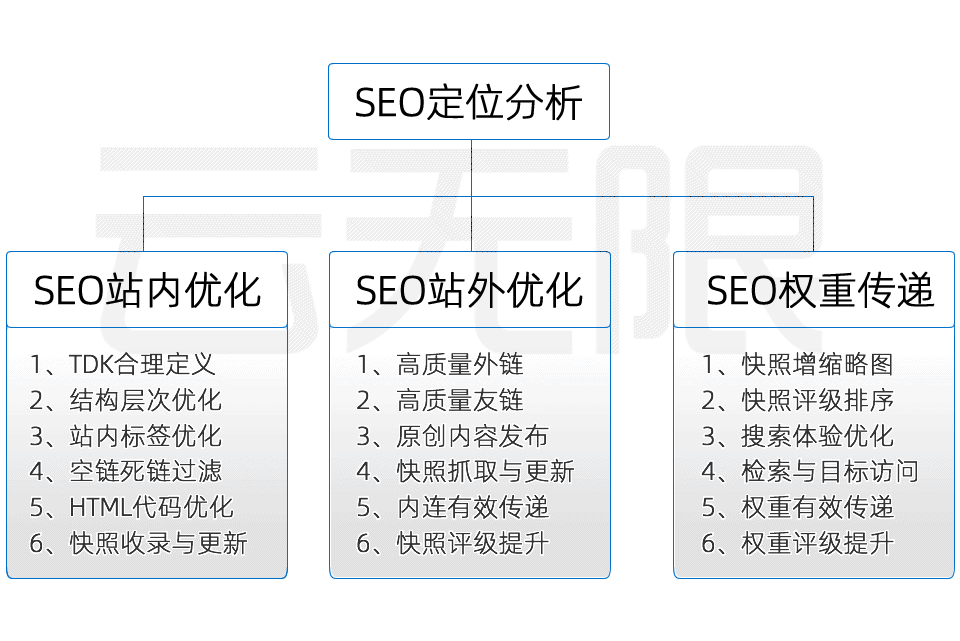

SEO策略

搜到你

让用户搜到你的网站是做SEO优化的目标,拥有精湛的SEO技术、丰富的经验技巧以及对SEO规则的深刻把握才有机会获得更云无限!

了解你

确保网站内容清晰、准确、易于理解,使用户能够轻松找到所需信息.使用简洁明了的标题和描述,帮助用户快速了解你的产品服务!

信任你

将企业的核心价值、差异化卖点、吸引眼球的宣传语等品牌词尽可能多的占位搜索前几页,增强用户印象,优化用户体验让访客信任你!

选择你

优化落地页引导用户咨询或预约留言,引用大型案例或权威报道彰显品牌实力,关注用户需求和反馈,不断优化产品服务让用户选择你!

关键词研究

品牌关键词

提升品牌知名度、塑造品牌形象,吸引对品牌感兴趣的用户,同时帮助监测品牌在搜索引擎中的表现。

核心关键词

是网站内容的主要焦点,能吸引大量目标受众,提高网站在相关搜索中的排名。搜索量大,竞争较激烈。

长尾关键词

更能够更精确地定位目标受众,提高转化率,竞争相对较小更容易获得排名,更符合用户的具体搜索意图。

区域关键词

针对特定地区进行优化,帮助本地企业吸引当地用户,提高本地市场的曝光度。适用于有地域性需求的企业。

竞品关键词

与竞争对手品牌或产品相关的词,通过分析这些关键词,可以了解竞争对手的优势和劣势。

产品关键词

直接针对产品进行优化,与具体产品或服务直接相关,如产品名称、型号、功能等描述性词汇。

搜索下拉词

反映用户的搜索习惯和需求,是搜索引擎根据用户输入自动推荐的词汇,与用户搜索意图高度相关。

相关搜索词

提供与主题相关的其他搜索词汇,帮助用户发现更多相关内容,同时扩展网站的优化范围。

站内SEO

TDK优化

力争一次性完成网站页面标题、描述、关键词的的合理部署

链接优化

包含LOGO链接、导航链接、文章链接及外部链接等SEO优化设置

HTML优化

HTML代码、标签等优化:H,alt,strong,title,span,title等标签

内容优化

固定内容与关键词SEO匹配、动态内容提升蜘蛛抓取率增强快照评级

站外SEO

1)降低文章内容在搜索结果的重合度。尤其是文章标题、段落主题、内容摘要等;

2)标题包含关键词(可包含部分或完整匹配)字数控制在24字内;

3)提炼的文章概要(100字内)必须与关键词有相关性才有意义;

4)新文章不要增加锚文本超链接,等文章快照有排名后再扩充锚文本链接;

5)文章内容与标题关键词相呼应,建立关联,也可根据关键词扩充有关的内容;

6)文章中的图片最好增加alt属性,图片不要失真和变形,宽度大于500px更优机会抢占搜索快照缩略图;

7)文章排版合理、段落分明、段落主题用H标签加强,段落内容用span或p标签区分;

8)发布文章后先引导收录。如提交搜索引擎登录、合理使用有排名快照的内部链接;

9)如果文章7天还没有收录,就要提升文章内容质量再发布;

SEO优化

SEO优化 搜索引擎SEO

搜索引擎SEO  自然流量

自然流量